في تجربة بسيطة لا ترقى إلى ما يحدث في المختبرات، لكنها المتاح حاليّاً، يجري الحوار التالي بينك وبين مساعد جوجل:

- أنا حزين.

- أتفهم شعورك فأنا أتعلم ممارسات بسيطة للتغلب على الحزن، هل ترغب بسماعها؟

تضغط على زر (نعم).

يعطيك المساعد عدة خيارات لتجربها في محاولة التخفيف من الحزن، كترتيب السرير والقيام بنشاط، والاستماع إلى موسيقى قديمة، في ظل نفاد صبر المساعد الرقمي، الذي وبعد ثوانٍ على قول “أنا حزين”، يطلب منك فوراً أن “تقول ذلك بطريقة أخرى”، أو “هل ترغب باقتراح آخر”.

ربما تأخذنا هذه الرحلة على الأزرار قليلاً من حزننا، وقد تجدي خيارات المساعد الرقمي نفعاً.

لكن، كيف سيكون الحال لو كان الذكاء الاصطناعي يشعر بنا؟ هل سيؤدي ذلك إلى تحسن ملحوظٍ في حياتنا على أرض الواقع؟ هل يمكن أن يشعر الذكاء الاصطناعي أصلاً، ليتحول إلى ذكاء اصطناعي عاطفي؟

الشعور: من الدماغ إلى الخوارزميات

أظهرت دراسة نُشرت في دورية “كارنت بيولوجي” (Current Biology) أجراها باحثون في المعهد الهولندي للعلوم العصبية، أن الفئران تشعر بالتعاطف تجاه بعضها بعضاً، حيث تنشط القشرة الحزامية الأمامية الموجودة في الدماغ لدى النظر إلى فأر آخر يتألم. ويوضح الباحثون في الدراسة أن خلايا عصبية تسمى “الخلايا العصبية المرآتية” (Mirror Neurons)) تعكس آلام الآخرين سواء لدى الفئران أو البشر. فعلى أي أساس تُبنى استجابات المساعدات الرقمية لدى بوحنا بشعورنا لها، أو وضعها في أي من المواقف التي تستدعي استجابات عاطفية؟ بشكل بديهي سنقول إن هذا عمل الخوارزميات.

حين اخترع جون مكارثي ومارفن مينسكي وآخرون الذكاء الاصطناعي عام 1955، أعجبا بقدرات الآلة. كان يُعتقد حينها أن الفوز بمباراة شطرنج سيعد قمة المهام الصعبة التي يمكن للذكاء الاصطناعي إنجازها، لكن تبين بعد 60 عاماً على انطلاق الذكاء الاصطناعي، أن الفوز بمباراة شطرنج كان أمراً سهلاً، أمام نوع آخر من المهام، كالشعور.

يحدث الشعور بشكل تلقائي لدى البشر، وعلى الرغم من تفاوت إدراك البشر، بيد أن لنا القدرة على تفسير ما نشعر به وتوصيفه، ويملي علينا ذلك بالنتيجة سلوكنا أو رد الفعل الذي سنتبناه. فهل يمكن تعليم هذه الطريقة من التفاعل للآلة؟ الإجابة المبدئية نعم، ولكن…

اقرأ أيضاً: قرارات تكنولوجية ذاتية تجعل 2022 عاماً أفضل بالنسبة لك

ما هو الذكاء الاصطناعي العاطفي؟

“الذكاء الاصطناعي العاطفي” (Emotion AI)، الذي يُطلق عليه أيضاً الحوسبة العاطفية أو “الحوسبة الوجدانية” (Affective Computing)، هو فرع سريع النمو من الذكاء الاصطناعي يسمح لأجهزة الكمبيوتر بتحليل وفهم الإشارات البشرية غير اللفظية مثل تعابير الوجه ولغة الجسد والإيماءات ونغمات الصوت لتقييم حالة المستخدم العاطفية. له العديد من التطبيقات من حولنا، وسنأتي على ذكرها لاحقاً.

كيف يتم تحليل المشاعر باستخدام الذكاء الاصطناعي؟

لننطلق من البشر، إن لم تستخدم اللغة صراحةً لتوصيف ما تمر به من حالة مزاجية أو ما يعتريك من مشاعر، يمكنك أن تكتب رسائل أو مذكرات، أو غيرها، أي ستلجأ إلى النصوص، وربما يقوم آخر بقراءة هذه النصوص أو النظر إلى وجهك وما تعكسه تعبيراته بالإضافة إلى لغة الجسد.

بنفس الطريقة، يمكن تحليل المشاعر باستخدام الذكاء الاصطناعي وذلك اعتماداً على:

1- معالجة اللغات الطبيعية

يمكن استخدام معالجة اللغات الطبيعية وتحليل النصوص واللغويات الحسابية والقياسات الحيوية لتحديد واستخراج وقياس ودراسة الحالات العاطفية والمعلومات الذاتية بشكل منهجي. وهذا ما يُسمى بتحليل المشاعر بالاعتماد على النصوص.

يلعب تحليل المشاعر دوراً مهماً في فهم بعض العوامل النفسية الكامنة وراء كيفية عمل الذكاء الاصطناعي في سيناريوهات معينة. مثلاً، تعتبر الكلمات الإيجابية مثل جيد، لطيف، سعيد، جوانب إيجابية ويتم ربط الاستخدام المتكرر لهذه الكلمات بنهج أكثر إيجابية. بينما يرتبط استخدام الكلمات السلبية مثل سيء، حزين، رهيب، قبيح بنهج أكثر سلبية.

تعمل هذه الطريقة باستخدام خوارزميات تعلم آلي وتعلم عميق، وهي نفسها التي يمكن بها مراقبة المحتوى على وسائل التواصل الاجتماعي كفيسبوك وتويتر. فمثلاً، تعتمد فيسبوك خوارزميات تعمل بنفس المبدأ لتصفية المحتوى المروج للانتحار.

لكن، مهما كانت معرفتك بصاحب النصوص عميقة، لا شيء يُقارن بمشاهدتك له والنظر إليه، لإعطاء تقييم جيد لحالته العاطفية. بالمثل تبقى البيانات التي يتم جمعها باستخدام الصور أو الفيديوهات أفضل من النصوص، وهنا أصبحنا في الطريقة الثانية.

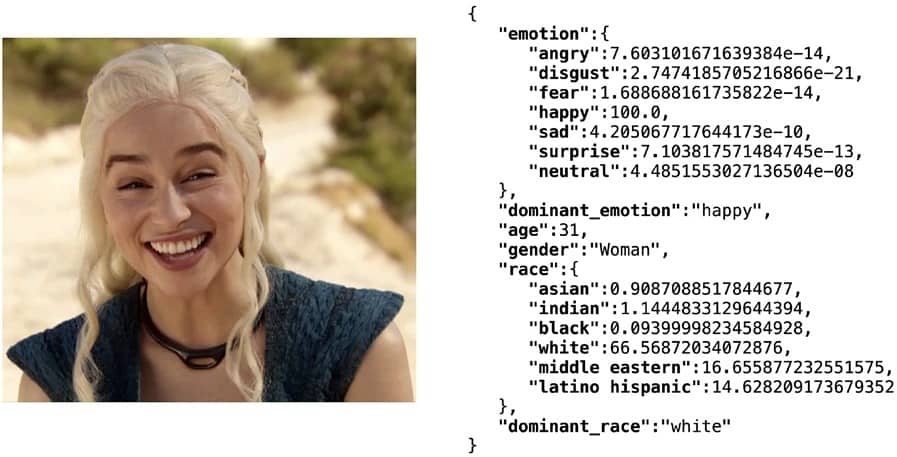

2- التعرف البصري على المشاعر باستخدام الذكاء الاصطناعي

التعرف البصري على المشاعر بالذكاء الاصطناعي VEA هو محاولات الآلات المستخدمة تحليل وتفسير وتصنيف المشاعر البشرية من خلال تحليل ملامح الوجه.

تحليل لتعابير الوجه باستخدام ديب فيس DeepFace

يعتبر “التعرف البصري على المشاعر باستخدام الذكاء الاصطناعي” (VEA) أحد أكثر المهام تحدياً للخوارزميات، والسبب هو الفجوة الموجودة بين ما تلتقطه الكاميرا من صور أو فيديوهات والخلفية العاطفية الحقيقية التي تتوارى خلف هذا الوجه. وعلى الرغم من ذلك لا يزال تحليل المشاعر المرئية واعداً.

اقرأ أيضاً: كيف يتحكم الذكاء الاصطناعي فيما تراه على وسائل التواصل الاجتماعي؟

كيف يتم تحليل المشاعر عبر التعرف البصري باستخدام الذكاء الاصطناعي؟

تتم عملية تحليل المشاعر بالتعرف البصري اعتماداً على الذكاء الاصطناعي باتباع ثلاث خطوات:

- اكتشاف الوجه في الصور وإطارات الفيديو: يتم استخدام صور أو فيديو تلتقطه الكاميرا لاكتشاف وتحديد وجه الإنسان. يتم استخدام إحداثيات الصندوق المحيط للإشارة إلى موقع الوجه الدقيق في الوقت الفعلي. لا تزال مهمة اكتشاف الوجوه تمثل تحدياً ولا يمكن ضمان أن يتم اكتشاف جميع الوجوه في صورة إدخال معينة، خاصة في البيئات غير المنضبطة.

- معالجة الصورة: عند اكتشاف الوجوه يتم تحسين بيانات الصورة قبل إدخالها في مصنف المشاعر. تعمل هذه الخطوة على تحسين دقة الكشف بشكل كبير. عادةً ما تتضمن المعالجة المسبقة للصورة خطوات فرعية متعددة لتطبيع الصورة لتغييرات الإضاءة، وتقليل الضوضاء وتجانس الصورة، وتصحيح دوران الصورة وتغيير حجمها واقتصاصها.

- نموذج الذكاء الاصطناعي لتصنيف المشاعر: يتم استرداد الميزات ذات الصلة من البيانات المعالجة مسبقاً التي تحتوي على الوجوه المكتشفة. هناك طرق مختلفة للكشف عن العديد من ملامح الوجه وحركة معالم الوجه والمسافات بينها وميزات التدرج ونسيج الوجه، والمزيد. بشكل عام، تعتمد المصنفات المستخدمة في التعرف على المشاعر بالذكاء الاصطناعي على “الشبكات العصبونية الملتفة” (CNN). في الخطوة الأخيرة، يتم تصنيف الوجه البشري المُكتشف بناءً على تعبيرات الوجه عن طريق تعيين فئة محددة مسبقاً مثل “سعيد” أو “محايد”.

اقرأ أيضاً: باحثون من إم آي تي يطورون طريقة مبتكرة لتقليل تحيز الذكاء الاصطناعي

ما هي المشاعر التي يمكن تحليلها باستخدام الذكاء الاصطناعي؟

بالاعتماد على مجموعة من قواعد البيانات يمكن أن تساعدنا الخوارزميات على تصنيف المشاعر الآتية:

- الغضب.

- الاشمئزاز.

- الخوف.

- السعادة.

- الحزن.

- المفاجأة.

- تعابير محايدة.

ما هي الأدوات التي تُستخدم في تحليل المشاعر باستخدام الذكاء الاصطناعي؟

تُنجز عملية التحليل باستخدام الكثير من البرمجيات التي يمكن أن تعالج النصوص أو الصور أو حتى الإيماءات، لاستخراج الحالة المزاجية. من أشهر هذه الأدوات:

- “براند24” (Brand24): تعد Brand24 أداة رصد تحلل المشاعر بالاعتماد على الوسائط المتعددة. يتم توفير مراقبة الوسائط الاجتماعية عبر الإنترنت بواسطة Brand24، وتغطي الأداة جميع الشبكات والمدونات والمنتديات والمواقع الإلكترونية والمواقع الإخبارية والبودكاست والنشرات الإخبارية الرئيسية على الإنترنت.

- “كلارابريدج” (Clarabridge): تشكل جزءاً من نظام إدارة تجربة العملاء في الشركات. عند تصنيف جزء من الكتابة، يتم أخذ القواعد النحوية والسياق والصياغة والمصدر في الاعتبار. تعتبر أداة تصنيف المشاعر هذه مثالية لجمع ملاحظات العملاء وتحديد ما إذا كانت إيجابية أم سلبية أم محايدة.

- “ريبيوستيت” (Repustate): ريبيوستيت هو تطبيق لتحليل المشاعر يقدم تحليلات نصية بـ 17 لغة مختلفة للمؤسسات. تقوم هذه التقنية على تفكيك أجزاء من النص إلى أقسام نحوية قبل أن يبدأ التحليل الحقيقي. بمجرد الانتهاء من هذه الخطوة، سيسهل تحديد الكلمات الأكثر إثارة للاهتمام من حيث تحليل المشاعر.

بالإضافة إلى أدوات مثل “ساب هانا” (SAP HANA) و”أوبن تيكست” (OpenText) و”بارالل دوتس” (ParallelDots) ومحلل IBM Watson Tone و”ليكساليتكس” (Lexalytics) و”هاي تيك” (Hitech) و”الأتمتة المعرفية للنظام الخبير” (Expert System’s Cognitive Automation).

اقرأ أيضاً: أهم العبر من قصة تطور الذكاء الاصطناعي منذ هزيمة كاسباروف حتى التعلم العميق

ما هي التطبيقات العملية لاستخدام الذكاء الاصطناعي في التعرف على المشاعر وتحليلها؟

- الإعلانات: في عام 2009 أسست رنا القليوبي وبيكارد شركة “أفيكتفا” (Affectiva)، وهي شركة ذكاء اصطناعي عاطفي مقرها في بوسطن متخصصة في تطبيقات الذكاء الاصطناعي العاطفي في السيارات ذاتية القيادة وأبحاث الإعلان. تستخدم التقنية هاتف الشخص أو كاميرا الكمبيوتر المحمول لالتقاط ردود أفعاله أثناء مشاهدة إعلان معين، وذلك للحصول على استجابة في الوقت الفعلي تسمح للمسوقين بمعرفة ما إذا كان إعلان معين له صدى لدى الناس أو ما إذا كان مسيئاً أو يحصل على نتيجة حيادية أو يلقى قبولاً.

- مراكز الاتصال: تساعد التكنولوجيا المقدمة من شركات مثل”كوغيتو” (Cogito)، وهي شركة تأسست في عام 2007 بواسطة MIT Sloan Alumni، وكلاء مركز الاتصال على تحديد الحالة المزاجية للعملاء على الهاتف في الوقت الفعلي. يعتمد برنامج التحليلات الصوتية من كوغيتو على سنوات من أبحاث السلوك البشري لتحديد أنماط الصوت.

- الصحة العقلية: في ديسمبر/كانون الأول 2018 أطلقت كوغيتو برنامجاً فرعياً يسمى “كومبانين إم إكس” (CompanionMx)، وتطبيقاً مصاحباً لمراقبة الصحة العقلية. يستمع تطبيق كومبانين إلى شخص يتحدث في هاتفه ويحلل صوته بحثاً عن علامات القلق وتغيرات الحالة المزاجية.

يعمل التطبيق على تحسين وعي المستخدمين الذاتي، ويمكن أن يزيد من مهارات التأقلم بما في ذلك خطوات للحد من التوتر. وهناك تقنية أخرى للصحة العقلية تعمل بالذكاء الاصطناعي وهي جهاز “بايو إيسنس” (BioEssence) القابل للارتداء والمطور في MIT Media Lab حيث يراقب نبضات قلب الشخص لمعرفة ما إذا كان يعاني من شيء مثل التوتر أو الألم أو الإحباط. ثم تطلق الشاشة رائحة لمساعدة مرتديها على التكيف مع المشاعر السلبية التي يمر بها في تلك اللحظة. قام باحثو Media Lab أيضاً ببناء خوارزمية باستخدام بيانات الهاتف وجهاز يمكن ارتداؤه تتنبأ بدرجات متفاوتة من الاكتئاب.

- السيارات ذاتية القيادة: يعمل خافيير هيرنانديز، الباحث في مجموعة الحوسبة الوجدانية Affective Computing Group، حالياً مع فريقه للاستفادة من الذكاء الاصطناعي العاطفي في المركبات، فعادة ما يتم إيلاء الاهتمام لعوامل السلامة خارج السيارة، أما بالاعتماد على الذكاء الاصطناعي العاطفي وتطبيقاته فيتم اليوم باستخدام المؤشرات الحيوية وتحليل المشاعر بالتعرف البصري معرفة حالة تركيز السائق وتنبيهه، وتطبيق الإجراءات الكفيلة بسلامته.

- الخدمات المساعدة للأشخاص ذوي الاحتياجات الخاصة: يجد بعض الأشخاص المصابين بالتوحد صعوبة في التواصل عاطفياً. هذا هو المكان الذي يمكن أن يكون فيه الذكاء الاصطناعي العاطفي نوعاً من “التكنولوجيا المساعدة”، كما يقول خافيير هرنانديز، حيث يمكن لبعض الشاشات القابلة للارتداء أن تلتقط التفاصيل الدقيقة في تعابير الوجه أو لغة الجسد لدى شخص مصاب بالتوحد (مثل ارتفاع معدل النبض) والتي قد لا يتمكن الآخرون من رؤيتها.

ووفقاً لهيرنانديز إن هناك أيضاً “أطراف صناعية تواصلية” تساعد الأشخاص المصابين بالتوحد على تعلم كيفية قراءة تعابير وجه الآخرين. أحد الأمثلة على ذلك هو لعبة يستخدم فيها الشخص الكاميرا على جهاز لوحي لتحديد الوجوه “المبتسمة” أو “الغاضبة” للأشخاص من حوله. حيث تقيس تقنية الفيديو هذه الحالة المزاجية في الوجوه “المبتسمة” أو “الغاضبة” أو “الحيادية”.

اقرأ أيضاً: هل يشكل الذكاء الاصطناعي تهديداً لوظائف البشر؟

ما هي مخاطر استخدام الذكاء الاصطناعي في تحليل المشاعر وتصنيفها؟

على الرغم من المميزات الكثيرة التي يمكن الحصول عليها مع استخدام الذكاء الاصطناعي في تحليل المشاعر، لكن هناك مخاطر مرافقة بكل تأكيد، وتتجلى أهمها في النقاط الآتية:

- التحيز: بسبب الطبيعة الموضوعية للعواطف، يعد استخدام الذكاء الاصطناعي في تحليلها مرتعاً خصباً للتحيز، فوفقاً لإحدى الدراسات، ربطت تكنولوجيات تحليل المشاعر باستخدام الذكاء الاصطناعي مشاعر سلبية بأشخاص من إثنيات معينة أكثر من غيرهم، ولا تخفى تداعيات ذلك في أماكن العمل حيث سينعكس ذلك على تقييم الأشخاص الذين يتم تقييمهم بمشاعر سلبية.

- فشل الذكاء الاصطناعي في التمييز بين الفروقات الثقافية: يختلف تفسير تعابير الوجه والإيماءات والابتسامات بين ثقافة وأخرى، فمثلاً تميل شعوب آسيا إلى الابتسام من باب إظهار اللطف والأدب بينما يقتصد الأوروبيون بالابتسام، فلنفرض أن أحد متاجر برلين اعتمد على أجهزة التعرف على المشاعر لتمييز رضا العملاء، في هذه الحالة لن يحصل على تفسير صحيح لابتسامة سائح ياباني، فابتسامة الياباني هي إبداء للطف قبل طلب المساعدة، بينما واعتماداً على تحليل الجهاز، سيعتقد القائمون على المتجر أنه ليس بحاجة للمساعدة.

- تنميط تقييم المشاعر بناءً على ما تقوله الخوارزميات: إن لم تُعالج مشكلة التحيز في الخوارزميات، قد يشيع ذلك نموذجاً واحداً للمشاعر سواء الواعية أو غير الواعية وعلى نطاق واسع.

- انتشار الحيادية أو عدم الراحة لدى المستخدم: لا سيما ذلك المستخدم الذي سيقع فريسة التساؤل إن كان ما يحدثه هو روبوت أو إنسان آخر، سيميل عندها الكثيرون للتكتم وعدم الارتياح خاصة مع تذكر مشاكل الخصوصية والتسريب والاختراقات التي يمكن أن نواجهها مع بوتات الذكاء الاصطناعي أو الخدمات المقدمة بناءً على تحليل المشاعر باستخدام الذكاء الاصطناعي.

اقرأ أيضاً: أهم تطبيقات الذكاء الاصطناعي في مختلف القطاعات

فوائد استخدام الذكاء الاصطناعي لتحليل المشاعر

هناك العديد من الفوائد التي يمكن أن تنعكس عن صعيدين شخصي وعام:

- التطبيب عن بعد في أمراض الصحة العقلية: يمكن أن تقدم نماذج ذكاء اصطناعي مدربة جيداً تقييماً جيداً لحالة المرضى الذين قد يشعرون براحة أكبر لدى التحدث مع نماذج الذكاء الاصطناعي.

- تقييم الموظفين في أماكن العمل: بناءً على ما تقوله هذه النماذج عن حالة الموظفين ومؤشراتهم المزاجية في أماكن العمل، بحيث يتمكن أصحاب العمل من تحسين واقع العمل بما ينعكس على سلوكات الموظفين، أو تقديم الحلول الملائمة لهم.

- تقديم منتجات ترضي العملاء: عبر تقييم رضا عينة واسعة من العملاء على منتج، ويشبه ذلك ما قامت به شركة أفيكتيفا حيث تم تصوير ملايين المستخدمين وجمع بيانات عن حالتهم الوجدانية أثناء مشاهدة إعلان ما للمساعدة في تحسين المنتج المقدم.

- في التعليم: حيث يمكن أن تساعد التقييمات المقدمة لحالة الطلاب على تعزيز تجربة التعليم، كما يمكن أن تساعد المعلمين على تحسين تجربتهم، إضافة إلى إيلاء الاهتمام الكافي للطلاب الذين يحتاجونه. ففي الصين، هناك أنظمة لتحليل المشاعر في بعض المدارس لتتبع مدى تركيز الطلاب.

اقرأ أيضاً: كيف يمكن إعادة بناء مستقبل العمل والعاملين في ظل الذكاء الاصطناعي؟

إن شعر الذكاء الاصطناعي، كيف سيؤثر ذلك على البشر؟

في فيلم Passengers المعروف، يؤرق المسافر بين المجرات “تيم بريستون” الذي استيقظ من سباته بطريق الخطأ، وبعد وحدة عام كامل، قلقه من مدى صحة إيقاظه لأورورا، المسافرة التي أعجبته، وأحب أن تؤنس وحدته المريرة في السفينة الفضائية. في خضم حيرته يطرح تيم هذا السؤال بطريقة عاطفية على الروبوت “آرثر” القائم على خدمة الحانة في المركبة. الروبوت مبرمج بطريقة لا يتوقعها أحد وربما تسبقنا بمئة عام، لكنّه وعلى الرغم من ذلك أجاب: “ليس هذا بالسؤال الذي تطرحه على روبوت”. كذلك لم يقدر خطورة بوحه بهذا السر المدمر بالنسبة لأورورا.

في كل ما كتبناه آنفاً، أتينا على ذكر “تحليل المشاعر باستخدام الذكاء الاصطناعي، لأنه، وبكل بساطة، لا يوجد ذكاء اصطناعي يمكن أن يشعر بنا، وليس من المتوقع أن يوجد عما قريب. قد تتحسن الخوارزميات، وربما يصل بعضها إلى الدرجة التي تهذب فيها المساعدات الرقمية من نبرة صوتها فتغدو أكثر عاطفية “بنظرنا”. لكنها لن تنفعل، لن تعبر عما ينتابها من مشاعر، أو بكلمات أخرى، لن تعبر عن حالة شعورية تشعرنا بأن من نتكلم له يبادلنا الشيء ذاته. إنها خوارزميات مهما تحسن أداؤها، قد لا تصل إلى المرحلة التي يمكننا أن نشعر فيها بالراحة التي نشعرها لحظة بكائنا على كتف من نحب. ببساطة، لن نشعر بدفء أحضان روبوت حتى لو زوِّد بمستشعرات يمكن أن ترفع درجة حرارته مع قيامه بهذا الفعل، الذي يعتبر من أوجه التعاطف بين البشر.

لكن، وفي سيناريو متفائل، كيف ستؤثر الحالة الشعورية المتبادلة بيننا وبين الروبوتات، ماذا لو شعرت بنا؟

يطيب للكثيرين تصوير الذكاء الاصطناعي في درجاته المتقدمة جداً على أنه المنافس الذي سيبيد البشر، لكن قد لا يكون الأمر بسوداوية سيناريوهات هوليوود، إذ يمكن لذكاء اصطناعي يتفاعل شعوريّاً مع البشر أن يمنح مناخاً أفضل للعالم. أو أن يشعر المستخدمين بالمزيد من الراحة الاجتماعية أثناء استخدامه، بالإضافة إلى فهم وترجمة مشاعر ذوي الاحتياجات الخاصة.

أوصى هيرنانديز بأن أي شركة مهتمة بتطبيق هذه التكنولوجيا تحتاج إلى تعزيز مناقشة صحية – مناقشة تتضمن فوائدها وما هو ممكن مع التكنولوجيا وكيفية استخدامها بطرق خاصة.

ما يجب أن نأخذه بالاعتبار هو أن التكنولوجيا تكون جيدة إن كان مبرمجها جيداً، ويعي تماماً المخاطر المحتملة لذكاء اصطناعي عاطفي. ثم، ألا يجب أن نخشى على هذه الكيانات من تحيزنا اللاشعوري تجاه من يشبهنا؟